2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

👋 介绍

大家好,ComfyUI 的创作者们!你是否曾在生成图像时心想:“我真希望这个速度能快到飞起”?

如果你研究过加速人工智能模型推理,你很可能听说过 TensorRT。虽然目前市面上已有几个将 TensorRT 引入 ComfyUI 的自定义节点,但它们往往伴随着令人沮丧的权衡。你经常会听到这样的抱怨:“我再也无法使用我的 LoRA 模型了”,或者 “这个节点已经过时且无人维护……”

为了解决这些问题,我开发了 ComfyUI-TensorRT-Reforge!🚀 这是一个全新的自定义节点,让你既能享受 TensorRT 极致的速度优势,又能自由使用你钟爱的 LoRA 模型。

在本文中,我将带你一步步完成安装与使用,并深入探讨其背后的一些酷炫技术原理。让我们开始吧!👇

🙌 致谢

本项目基于 ComfyUI 作者 comfyanonymous 最初创建的优秀项目 ComfyUI-TensorRT。在此向他们致以诚挚的感谢!

🛠️ 功能概览

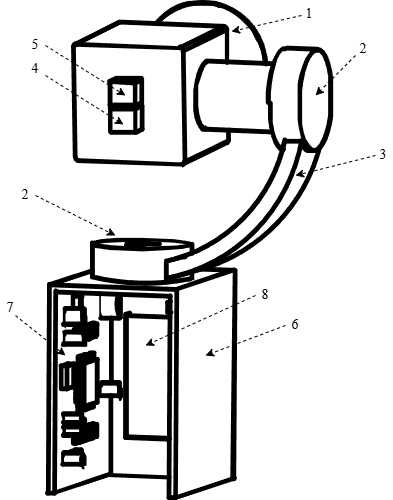

ComfyUI-TensorRT-Reforge 设计简洁,包含两个核心自定义节点:

- TensorRT 导出器 Reforge(导出器)

- TensorRT 加载器 Reforge(加载器)

它们的功能非常明确。

首先,导出器会将你标准的 .safetensors 模型转换为高度优化的 TensorRT 模型。接着,加载器将转换后的模型导入 ComfyUI,并对其进行封装,使你可以像使用普通模型一样无缝使用它。

💻 系统要求

以下是本项目的要求以及我用于测试的环境:

| 项目 | 要求 | 我的测试环境 |

|---|---|---|

| 操作系统 | Windows 11/10、WSL、Ubuntu | WSL 上的 Docker(详见下方 Dockerfile) |

| 显卡 | RTX 2000 系列或更新型号 | RTX 4070 Ti |

| 显存 | 至少 8GB | 12GB |

| CUDA | 12.x | 12.8 |

| 模型 | SD1.5、SDXL、AuraFlow、Flux、SD3、Anima、SVD | SD1.5、SDXL、SD3、Anima |

⚠️ 关于 CUDA 版本的说明

目前官方暂不支持 CUDA 11 和 CUDA 13。不过,通过调整 ONNX/TensorRT 版本或导出选项,你或许能让它们正常工作。如果你成功在这些版本上运行,请务必在我们的 讨论区留言分享——我非常期待听到你的经验!

📦 安装方法

安装 ComfyUI-TensorRT-Reforge 与其他自定义节点一样简单。请选择最适合你工作流程的方式。

1. 通过 ComfyUI-Manager 安装(推荐)

如果你使用 ComfyUI-Manager,只需点击几下即可完成安装:

- 点击 ComfyUI 菜单中的 [管理器]。

- 打开 [自定义节点管理器]。

- 搜索

TensorRT-Reforge。 - 找到

ComfyUI-TensorRT-Reforge后,点击 [安装]。 -

免责声明:本文内容来自互联网,该文观点不代表本站观点。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容,请到页面底部单击反馈,一经查实,本站将立刻删除。